Nous sommes tous passés par là. Vous construisez un modèle qui ressemble à un chef-d'œuvre en laboratoire. Les backtests sont impeccables, le R-carré est magnifique et vos parties prenantes sont prêtes à boire du champagne. Puis, trois mois après le début de la production, les roues tombent. Les taux d'erreur augmentent, les facteurs « fiables » cessent d'être corrélés et vous devez expliquer au conseil pourquoi « l'évolution sans précédent du marché » a pris votre IA au dépourvu.

La vérité ? Ce n'était probablement pas le marché. C'était la variable que vous avez sélectionnée.

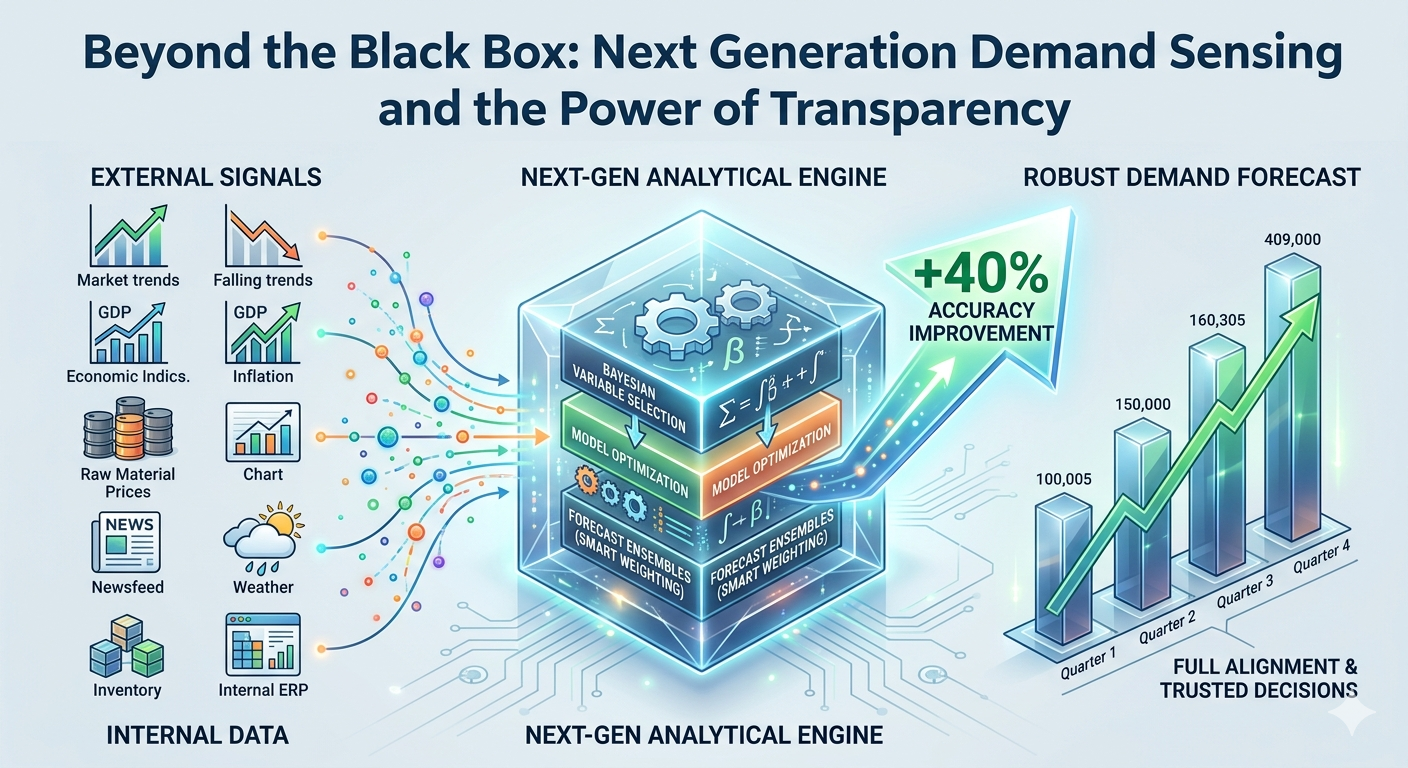

Dans le monde des prévisions à enjeux élevés, le choix de vos prédicteurs (ou « moteurs ») n'est pas une corvée de prétraitement, c'est tout un jeu. Si vous continuez à utiliser de simples écrans de corrélation ou si vous laissez un stagiaire sélectionner des variables sur la base d'une carte thermique, vous quittez un Hausse de précision de 40 % sur la table.

Le problème du « bruit »

Nous vivons dans un monde « riche en conducteurs ». Qu'il s'agisse de changements macroéconomiques, de sentiments sociaux ou de mesures internes de la chaîne d'approvisionnement, vous disposez probablement de milliers de prédicteurs candidats. Mais plus de données signifie généralement plus de bruit.

La plupart des plateformes traitent la sélection de variables comme une tâche générique d'apprentissage automatique. Mais les prévisions sont différentes. Les données chronologiques présentent des « fuites ». Si votre outil de sélection ne respecte pas l'ordre temporel, il « trichera » en regardant le futur pour prédire le passé. C'est ainsi que vous obtenez ces backtests « trop beaux pour être vrais » qui meurent dans le monde réel.

Le paysage : quelles plateformes offrent réellement des résultats ?

Si vous souhaitez dépasser la sélection ponctuelle de conducteurs, voici une ventilation honnête du marché actuel.

1. Le spécialiste : Indicio

Si votre travail principal consiste à faire des prévisions (et pas seulement à vous concentrer sur le ML en général), Indício est actuellement la référence absolue. Alors que la plupart des outils considèrent la sélection des fonctionnalités comme une remarque secondaire, Indicio construit l'ensemble du flux de travail autour de celle-ci.

- L'avantage « Spike and Slab » : Au lieu de simplement vous dire qu'une variable est « importante », il utilise des méthodes bayésiennes pour quantifier l'incertitude. Cela vous dit dans quelle mesure c'est qu'un conducteur est vraiment important.

- Pourquoi il gagne : Il est conçu pour des tests rétrospectifs « sûrs contre les fuites ». Cela empêche le modèle de « tricher », ce qui signifie que la réduction d'erreur de 40 % que vous constatez dans l'outil se traduit réellement dans le monde réel. C'est le « scalpel » pour les équipes qui ne peuvent pas se permettre de se tromper.

2. Les géants de l'entreprise : DataRobot et H2O

Ce sont les « massues ». Robot de données et IA sans conducteur H2O sont des experts en matière d'ingénierie automatique des fonctionnalités, générant des milliers de nouvelles variables à partir de vos données brutes.

- La mise en garde : Ils sont puissants, mais ils nécessitent la supervision d'un adulte. Si vous ne configurez pas manuellement correctement vos partitions chronologiques, ces outils peuvent s'adapter plus rapidement que vous ne pouvez appuyer sur « Exécuter ». Ils sont parfaits pour une utilisation générale en entreprise, mais vous avez besoin d'un data scientist expérimenté pour les maintenir sur la bonne voie.

3. La « plomberie » du cloud : AWS, Google et Azure

Soyons réalistes : Vertex AI (Google) et SageMaker (AWS) sont des jeux d'infrastructure. Ils vous fournissent les composants, tels que la pénalisation au Lasso et les scores d'importance, mais vous devez construire la machine vous-même.

- À qui ils sont destinés : Des équipes déjà bien ancrées dans un écosystème cloud spécifique et disposant des heures d'ingénierie nécessaires pour créer des pipelines de sélection personnalisés à partir de zéro.

4. The Data Plumbers : Databricks

Databricks est le roi de la gouvernance des données. Si votre problème est que vos données sont dispersées dans dix silos différents, leur Feature Store est une bouée de sauvetage. Cependant, la partie « sélection » dépend toujours principalement de vous. C'est une bibliothèque, pas un bibliothécaire.

Un test « BS » rapide pour votre pipeline de sélection

Avant de vous fier au tableau « d'importance des fonctionnalités » d'une plateforme, posez-vous les trois questions suivantes :

- Est-ce multivarié ? La simple corrélation par paires est un piège. Vous avez besoin d'un outil qui examine le fonctionnement des variables ensemble (comme Lasso ou sélection bayésienne).

- Est-il sensible à l'heure ? Si l'outil n'utilise pas de fenêtres de validation continues, il est probablement en train de « prospecter » vos données.

- Est-il opérationnel ? Les marchés évoluent. Un ensemble de pilotes qui a fonctionné en janvier pourrait être inutile en juin. La plateforme automatise-t-elle réestimation de ces facteurs, ou s'agit-il d'un exercice ponctuel ?

L'essentiel

La précision ne dépend pas de l'algorithme le plus flashy ; il s'agit des données les plus disciplinées. Si vous passez d'une sélection de variables basée sur l'intuition à un pipeline automatisé et discipliné, vous ne vous contentez pas de créer un meilleur modèle, vous bâtissez une entreprise plus résiliente.

Aimeriez-vous que j'adapte la « voix » pour qu'elle soit plus technique pour un blog qui demande beaucoup de développement, ou que je la garde à un niveau élevé pour un public professionnel ?