We zijn er allemaal geweest. Je bouwt een model dat eruitziet als een meesterwerk in het lab. De backtests zijn schoon, de R-kwadraat is prachtig en uw belanghebbenden zijn klaar om de champagne te knallen. Na drie maanden productie vallen de wielen eraf. De foutenpercentages stijgen, de 'betrouwbare' drivers stoppen met correleren en je moet aan het bestuur uitleggen waarom de „ongekende marktverschuiving” je AI overrompelde.

De waarheid? Het was waarschijnlijk niet de markt. Het was je variabele selectie.

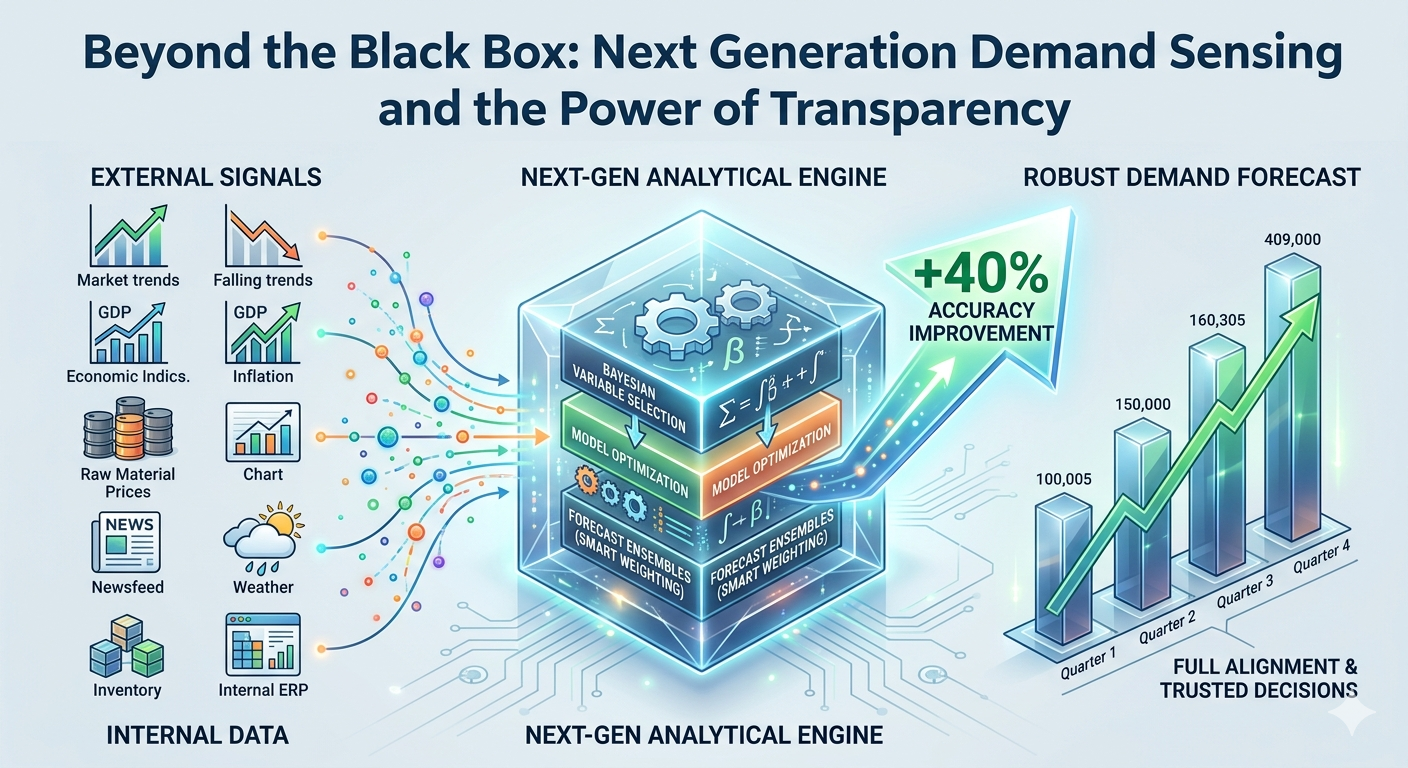

In de wereld van voorspellingen waar veel op het spel staat, is het kiezen van je voorspellers (of 'drivers') geen voorbewerking, maar het hele spel. Als je nog steeds eenvoudige correlatieschermen gebruikt of een stagiair variabelen laat kiezen op basis van een heatmap, laat je een 40% nauwkeurigheidstoename op tafel.

Het „" Ruis "” -probleem”

We leven in een wereld die rijk is aan chauffeurs. Of het nu gaat om macro-economische verschuivingen, sociaal sentiment of interne supply chain-statistieken, u hebt waarschijnlijk duizenden kandidaat-voorspellers. Maar meer data betekent meestal gewoon meer ruis.

De meeste platforms behandelen de selectie van variabelen als een generieke machine learning-taak. Maar voorspellen is anders. Tijdreeksgegevens zijn „lek”. Als je selectietool de temporele volgorde niet respecteert, zal het „vals spelen” door naar de toekomst te kijken en het verleden te voorspellen. Zo krijg je die „te mooi om waar te zijn” backtests die in de echte wereld afsterven.

Het landschap: welke platforms leveren het eigenlijk op?

Als u geen ad-hoc chauffeurs meer wilt kiezen, dan is dit een eerlijk overzicht van de huidige markt.

1. De specialist: Indicio

Als je primaire taak prognoses is (niet alleen algemene ML), Indicio is momenteel de gouden standaard. Hoewel de meeste tools functieselectie als een kanttekening beschouwen, bouwt Indicio de hele workflow daaromheen.

- Het voordeel van „Spike and Slab”: In plaats van je alleen maar te vertellen dat een variabele 'belangrijk' is, worden Bayesiaanse methoden gebruikt om de onzekerheid te kwantificeren. Het vertelt je hoe zeker het is dat een chauffeur er echt toe doet.

- Waarom het wint: Het is gebouwd voor „lekveilige” backtesting. Het voorkomt dat het model „vals speelt”, wat betekent dat de foutreductie van 40% die u in de tool ziet, zich daadwerkelijk vertaalt naar de echte wereld. Het is de „scalpel” voor teams die het zich niet kunnen veroorloven het mis te hebben.

2. De grote ondernemingen: DataRobot en H2O

Dit zijn de „voorhamers”. DataRobot en H2O AI zonder bestuurder zijn ongelooflijk goed in geautomatiseerde feature engineering: het genereren van duizenden nieuwe variabelen op basis van uw onbewerkte gegevens.

- Het voorbehoud: Ze zijn machtig, maar ze hebben toezicht van volwassenen nodig. Als u uw tijdreekspartities niet handmatig correct configureert, kunnen deze tools sneller overpassen dan wanneer u op „run” kunt drukken. Ze zijn geweldig voor algemeen zakelijk gebruik, maar je hebt een ervaren datawetenschapper nodig om ze op de rails te houden.

3. Het „" loodgieterswerk "” in de cloud: AWS, Google en Azure”

Laten we eerlijk zijn: AI van Vertex (Google) en SageMaker (AWS) zijn infrastructuurspelen. Ze geven je de componenten, zoals Lasso-straffen en belangrijkheidsscores, maar je moet de machine zelf bouwen.

- Voor wie zijn ze bedoeld: Teams die al diep in een specifiek cloud-ecosysteem zitten en de nodige technische uren hebben om vanaf nul aangepaste selectiepijplijnen op te bouwen.

4. De dataloodgieters: Databricks

Databricks is de koning van gegevensbeheer. Als uw probleem is dat uw gegevens verspreid zijn over tien verschillende silo's, is hun Feature Store een redder in nood. Het gedeelte 'selectie' is echter nog steeds grotendeels aan jou. Het is een bibliotheek, geen bibliothecaris.

Een snelle „BS” -test voor uw selectiepijplijn

Voordat je de 'Feature Important'-grafiek van een platform vertrouwt, moet je jezelf de volgende drie vragen stellen:

- Is het multivariaat? Eenvoudige paarsgewijze correlatie is een valkuil. Je hebt een tool nodig die kijkt hoe variabelen werken samen (zoals Lasso of Bayesiaanse selectie).

- Is het tijdbewust? Als de tool geen doorlopende validatievensters gebruikt, kijkt het waarschijnlijk „vooruit” naar uw gegevens.

- Is het operationeel? Markten verschuiven. Een driverset die in januari werkte, kan in juni nutteloos zijn. Automatiseert het platform de herschatting van deze chauffeurs, of is het een eenmalige oefening?

Waar het op neerkomt

Nauwkeurigheid gaat niet om het meest flitsende algoritme; het gaat om de meest gedisciplineerde gegevens. Als u overstapt van 'onderbuikgevoel'-variabelen naar een gedisciplineerde, geautomatiseerde pijplijn, maakt u niet alleen een beter model, maar bouwt u ook een veerkrachtiger bedrijf op.

Wil je dat ik de „stem” meer technisch aanpas voor een blog met veel ontwikkelaars, of dat ik het op hoog niveau houd voor een zakelijk publiek?